Falcon Le pinacle des LLM open-source

Falcon L'apogée des LLM open-source

L’écart entre les LLM open-source et propriétaires ne cesse de se réduire…

La recherche récente sur les modèles de langage LLM open-source a principalement porté sur deux domaines : l’apprentissage par imitation et la préformation de modèles de base open-source. Bien que les deux approches soient viables, la création de modèles de base open-source de haute qualité est particulièrement attrayante, car ces modèles peuvent être affinés ultérieurement (à moindre coût) et utilisés dans une variété d’applications différentes. Les premières tentatives de création de ces modèles ont échoué. Bien que les modèles ultérieurs (comme LLaMA et MPT-7B) soient bien meilleurs, ces modèles ont eu du mal à égaler la qualité de leurs homologues propriétaires (comme GPT-3.5 ou GPT-4) jusqu’à récemment.

Avec la sortie des modèles LLM Falcon-7B et Falcon-40B [1], nous constatons – pour la première fois – des modèles de base LLM open-source qui commencent à rivaliser avec la qualité des modèles payants les plus populaires. Ces modèles, formés sur un important corpus textuel obtenu via un nouveau pipeline de données, atteignent (avec une marge décente) de nouvelles performances de pointe parmi les LLM open-source et sont gratuits pour une utilisation commerciale. Pour améliorer les choses, les modèles Falcon adoptent plusieurs modifications de leur architecture de transformateur sous-jacente qui accélèrent considérablement l’inférence et peuvent même améliorer l’efficacité de la préformation.

![(from [1, 2])](https://ai.miximages.com/miro.medium.com/v2/resize:fit:640/format:webp/0*DwS_vMXDU3md9-Yz.png)

Le tableau d’ensemble. Le processus de création d’un LLM comprend plusieurs étapes ; voir ci-dessous. La première étape de ce processus (c’est-à-dire l’obtention d’un modèle de base préformé) est largement reconnue comme la plus coûteuse, tant en termes d’argent que de temps.

![Processus en plusieurs étapes pour la création et le perfectionnement d'un LLM (de [16,17])](https://ai.miximages.com/miro.medium.com/v2/resize:fit:640/format:webp/0*3OBYLUAOgAPo3UFh.png)

De tels modèles étaient auparavant gardés derrière des interfaces de programmation propriétaires, mais les avancées dans les LLM open-source ont rendu les LLM de base performants davantage accessibles au public. Falcon est un autre modèle de cette catégorie, et il atteint des niveaux de performance sans précédent par rapport à d’autres alternatives open-source.

- Le montage vidéo entre dans une nouvelle ère avec VideoCrafter modèles d’IA Open Diffusion pour une génération de vidéos de haute qualité

- Découvrez Mini-DALLE3 Une approche interactive texte-image en sollicitant de grands modèles de langage.

- Du texte au job de rêve Construire un recommender d’emploi basé sur l’IA avec Amazon SageMaker chez Talent.com

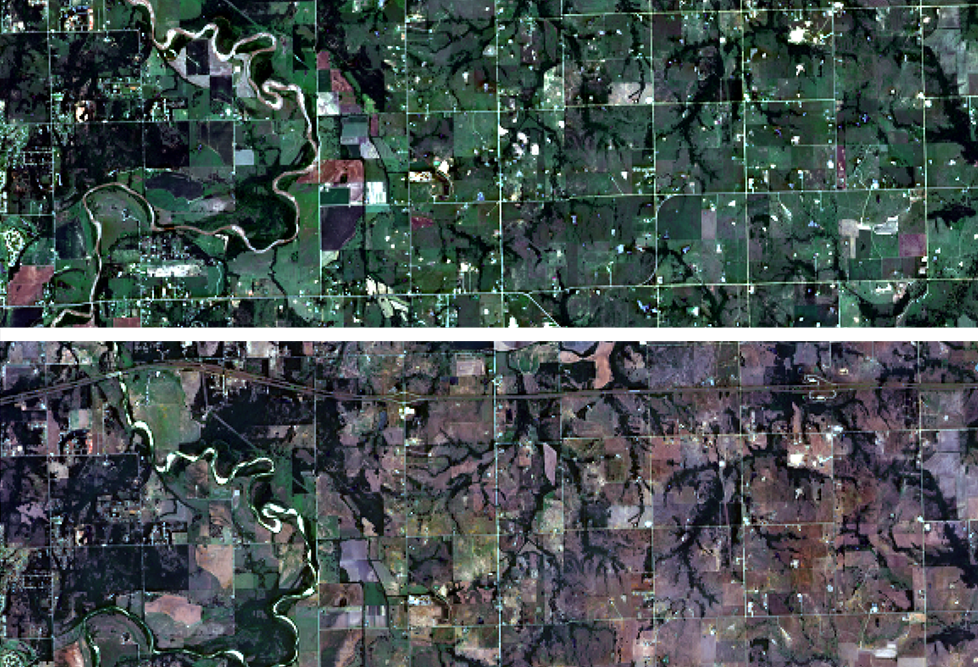

Utilisation de données Web pour la préformation de LLM

We will continue to update IPGirl; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- Optimisation des tâches répétitives lors de l’analyse exploratoire des données

- Comprendre et atténuer les hallucinations LLM

- Exploiter des APIs Serverless pour des modèles de diffusion stables avec les APIs Segmind

- PyTorchEdge dévoile ExecuTorch Donner du pouvoir à l’inférence sur les appareils mobiles et les appareils Edge.

- Découvrez BOSS un cadre d’apprentissage par renforcement (RL) qui forme des agents à résoudre de nouvelles tâches dans de nouveaux environnements avec l’aide du LLM.

- Décryptage de la mémorisation dans les réseaux neuronaux une plongée approfondie dans la taille du modèle, la mémorisation et la généralisation sur les bancs d’essai de classification d’images

- Street View à la rescousse l’apprentissage profond ouvre la voie à des bâtiments plus sûrs.